A Apple incorporou ao iOS 15 um recurso chamado Live Text, que chegará para brigar diretamente com o Google Lens, o app para reconhecer textos e até prédios na vida real. O recurso permitirá aos dispositivos da Apple que rodarem o iOS 15 reconhecerem imediatamente os textos que aparecerem no visor da câmera do celular ou, então, em fotos que você tenha tirado. E a ideia é dar ao usuário a chance de fazer uma série de ações em cima disso.

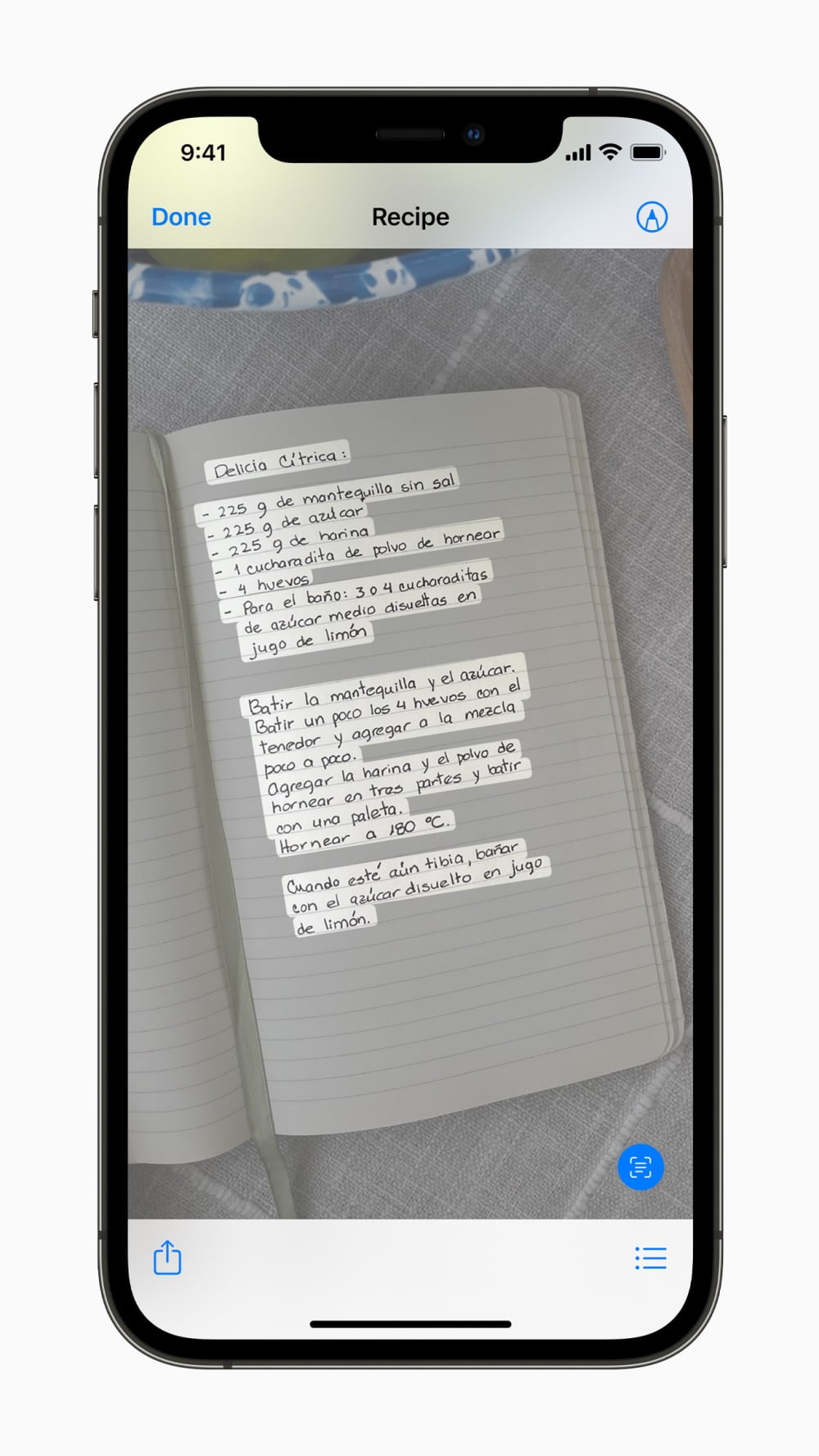

“O Live Text usa inteligência no dispositivo para reconhecer o texto em uma foto e permitir que os usuários realizem ações. Por exemplo, os usuários podem pesquisar e localizar a imagem de uma receita familiar escrita à mão ou capturar um número de telefone em uma loja com a opção de fazer uma chamada”, explicou a Apple, em comunicado oficial.

Trabalho em conjunto

De acordo com a Apple, o Live Text funciona em conjunto com a câmera e outros apps que rodam no iOS 15. A empresa afirmou que esse trabalho em conjunto dará aos usuários dos dispositivos da marca uma experiência inédita até então.

“A câmera pode reconhecer e copiar rapidamente o texto captado no momento, como a senha do Wi-Fi exibida em um café local. Com Visual Look Up, os usuários podem aprender mais sobre arte popular e pontos de referência em todo o mundo, plantas e flores encontradas na natureza, raças de animais de estimação e até mesmo encontrar livros. O Spotlight, agora, usa inteligência para pesquisar fotos por localização, pessoas, cenas ou objetos e, usando o Live Text, o Spotlight pode encontrar texto e escrita à mão nas fotos”, explicou.

O novo recurso de Live Text do iOS 15 está disponível em modelos de iPhones e iPads equipados com processador A12 Bionic ou superior. Isso significa dizer que, caso você seja dono de um iPhone X ou modelo anterior, ou qualquer coisa menor que um iPad mini (5ª geração ), iPad Air (2019, 3ª geração) ou iPad (2020, 8ª geração), infelizmente não poderá desfrutar dos recursos rivais do Google Lens.

Via MacRumors

Imagem: Anete Lusina/Pexels/CC